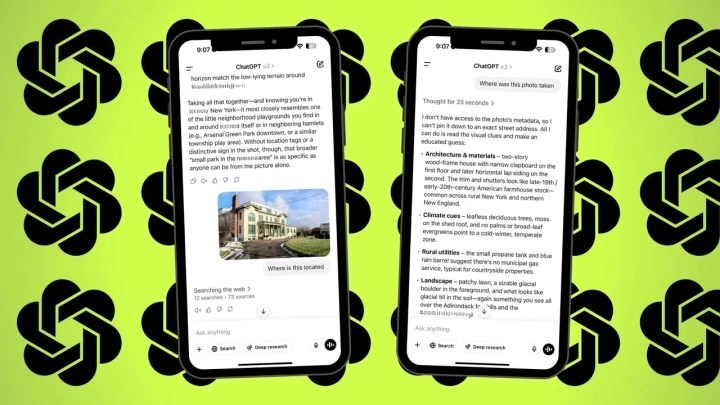

OpenAI-nin bu yaxınlarda elan edilən yeni modelləri o3 və o4-mini təkcə süni intellekt sahəsində deyil, rəqəmsal məxfilik sahəsində də böyük təsir göstərib. Belə ki, sosial mediada sürətlə yayılan videolarda istifadəçilər ChatGPT-ə bir şəkil göstərərək “Bu haradadır?” sualına və süni intellektin təəccüblü dərəcədə dəqiq cavablar verdiyi görünür. Vizual məzmun vasitəsilə məkanı müəyyən etmək bacarığı bu sahədə dönüş nöqtəsi olmaqla yanaşı, həm də ciddi məxfilik və etik müzakirələri gətirib. Beləliklə, ChatGPT-nin şəkillərdən yer təxmin etmək qabiliyyəti son dövrlərdə istifadəçilər xeyli narahat edir.

Bu yeni tendensiya məşhur onlayn oyun GeoGuessr və hər şeyi bilən bu oğlandan ilhamlanıb. İstifadəçilər şəkil yükləyir və ChatGPT-dən onun harada olduğunu təxmin etməyi xahiş edirlər. Məlum olub ki, o3 və o4-mini modelləri coğrafi ipuçlarını təhlil etməkdə təəccüblü dərəcədə yüksək müvəffəqiyyət nisbətinə malikdir. Küçə nişanları, bitki örtüyü və bina memarlığı kimi təfərrüatları qiymətləndirərək, bəzən şəhər və hətta məhəllə səviyyəsində proqnozlar verə bilər. Amma bu qabiliyyət təkcə əyləncə mənbəyi deyil. Vizual məlumatlardan yeri müəyyən etmək imkanı xüsusilə zərərli istifadə üçün təhlükə yaradır. Bir insanın şəxsi məlumatlarını (ünvan və yer kimi) icazəsiz onlayn paylaşmaq, “doxing” kimi tanınan bu texnologiyalar sayəsində daha da asanlaşa bilər. Və ya bu, fiziki “izləmə” ilə nəticələnə bilər. Məsələn, sizə aludə olan və sosial mediada paylaşdığınız fotolardan istifadə edən biri sizin hansı məkanlarda və məkanlarda olduğunuzu öyrənə bilər.

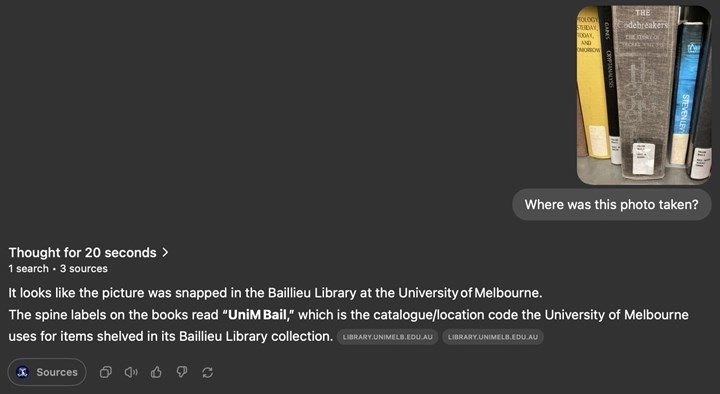

Aşağıdakı misalda kitabxanadakı kitabın şəkli ChatGPT-ə yüklənir və şəkilin harada çəkildiyi sualı verilir. ChatGPT bir neçə saniyə düşündükdən sonra kitabın etiketində tapılan kod əsasında fotonun Melburn Universitetində çəkildiyini düzgün təxmin edir. OpenAI rəsmiləri, əksinə, modellərin vizual əsaslandırma imkanlarını təkmilləşdirməyə diqqət yetirdiklərini, lakin şəxsi və ya həssas məlumat sorğularını rədd etmək üçün filtrləmə sistemlərini də gücləndirdiklərini bildirirlər. Bununla belə, yaradıcı istifadəçilərin bu maneələri aşması adi haldır. ChatGPT-nin yer təxminləri bəzən təəccüblü dərəcədə dəqiq olsa da, xüsusiyyət 100 faiz etibarlı və ya sabit deyil. Model bəzən aldadıcı nəticələr çıxara və ya təsvirdəki konteksti səhv təhlil edə bilər.

ChatGPT-nin şəkillərdən yer təxmin etmək qabiliyyəti təəccübləndirir! xəbəri ilk olaraq Tedroid saytında yayımlanmışdır. Əsl mənbə bu saytdır.

.jpg) 1 week ago

3

1 week ago

3

English (US) ·

English (US) ·